Ein Leitfaden zur Generativen KI-Prüfung: WEB-Anwendung Privatsphäre

35% der Technologieunternehmen setzen generative KI ein. In der heutigen digitalen Ära ist künstliche Intelligenz ein integraler Bestandteil unseres Lebens geworden. Generative KI, wie ChatGPT, bietet erstaunliche Fähigkeiten, wirft jedoch auch wichtige Datenschutzbedenken auf.

Dieser Artikel befasst sich mit der Generativen KI-Prüfung. Er untersucht die Risiken, denen Nutzer ausgesetzt sind, und wie sie ihre persönlichen Informationen schützen können.

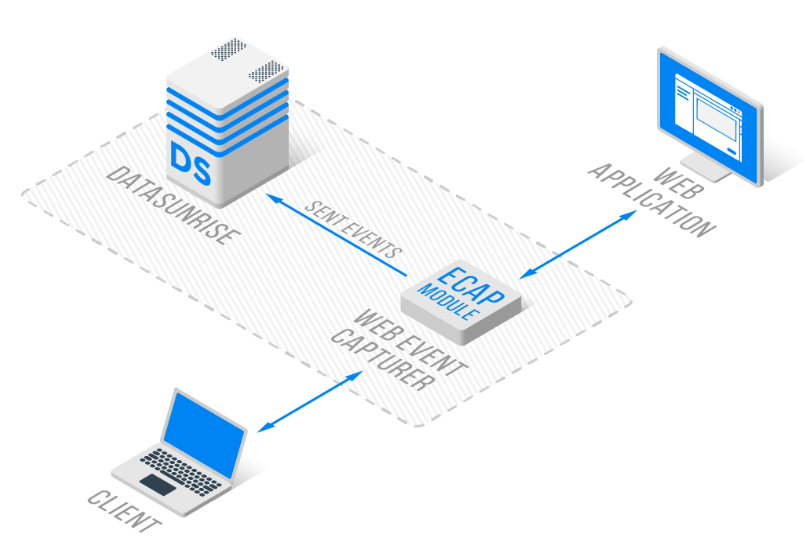

DataSunrise bietet jetzt einen fünften Betriebsmodus: Web-Anwendungsmodus. Dieser fortschrittliche Modus integriert modernste Technologien, um eine robuste und flexible Lösung zu liefern. Er integriert sich nahtlos in unsere bestehende Benutzeroberfläche und bietet gleichzeitig ein einheitliches Sicherheitsniveau für sowohl ChatGPT- als auch Salesforce-Anwendungen.

Benutzer können die gleichen vertrauten Werkzeuge verwenden, die sie auch für reguläre Datenbanken nutzen. Dies gewährleistet einen reibungslosen Übergang und eine konsistente Erfahrung über verschiedene Datenquellen hinweg.

Der Aufstieg der Generativen KI und ihre Datenschutzimplikationen

Generative KI hat revolutioniert, wie wir mit Technologie interagieren. Doch wenn Nutzer sich mit Plattformen wie ChatGPT verbinden, übersehen sie oft potenzielle Datenschutzrisiken. Das Verständnis dieser Risiken ist entscheidend zum Schutz persönlicher Informationen in einer zunehmend KI-getriebenen Welt.

Datenschutzrisiken bei der Nutzung von ChatGPT

Bei der Interaktion mit ChatGPT könnten Nutzer unwissentlich mehrere Datenschutzrisiken ausgesetzt sein:

- Datensammlung: ChatGPT speichert Konversationsverläufe, die möglicherweise sensible Informationen enthalten.

- Unbeabsichtigte Offenlegung von Informationen: Nutzer könnten versehentlich persönliche Details während der Gespräche teilen.

- Drittparteizugriff: Es besteht die Möglichkeit eines unbefugten Zugriffs auf gespeicherte Daten.

- AI-Lernen aus persönlichen Daten: Das AI-Modell könnte Nutzerdaten in seine Lernprozesse einbeziehen.

- Verknüpfung von Sitzungsinformationen: Mehrere Gespräche könnten miteinander verknüpft werden, was Muster über den Nutzer offenbaren könnte.

Schutz persönlicher Informationen bei ChatGPT-Anfragen

Um Datenschutzrisiken bei der Nutzung von ChatGPT zu mindern, sollten diese Strategien in Betracht gezogen werden:

- Minimierung persönlicher Informationen: Vermeiden Sie es, unnötige persönliche Details in Ihren Anfragen zu teilen.

- Pseudonyme verwenden: Verwenden Sie, wenn möglich, maskierte Daten anstelle echter Namen.

- Vorsicht bei sensiblen Themen: Vermeiden Sie es, hochgradig persönliche Angelegenheiten zu diskutieren.

- Regelmäßiges Löschen des Chatverlaufs: Löschen Sie Ihren Gesprächsverlauf regelmäßig.

- Datenschutzrichtlinien überprüfen: Verstehen Sie, wie die Plattform mit Benutzerdaten umgeht und sie schützt.

Überprüfung von Chatsitzungen und API-Nutzung

Die Überprüfung von Chatsitzungen und API-Nutzung ist entscheidend für die Wahrung von Privatsphäre und Sicherheit. So gehen Sie vor:

Für Einzelpersonen:

Die regelmäßige Überprüfung Ihrer Gesprächsprotokolle ist ein wesentlicher Schritt zur Aufrechterhaltung der Privatsphäre bei der Nutzung generativer KI-Werkzeuge. Nehmen Sie sich die Zeit, Ihren Chatverlauf regelmäßig zu überprüfen. Achten Sie darauf, ob Sie versehentlich sensible Informationen geteilt haben.

Diese Praxis hilft Ihnen, potenzielle Datenschutzrisiken zu erkennen. Sie macht Sie auch bewusster dafür, welche Informationen Sie mit KI-Systemen teilen. Wenn Sie besorgniserregende Daten entdecken, sollten Sie erwägen, diese spezifischen Nachrichten zu löschen oder Ihren gesamten Chatverlauf zu löschen, falls notwendig.

Für diejenigen, die die API nutzen, ist das Monitoring der API-Schlüsselnutzung von entscheidender Bedeutung. Verfolgen Sie, wann und wie Sie Ihren Schlüssel verwenden, um sicherzustellen, dass er nicht in unbefugte Hände gefallen ist. Diese Wachsamkeit kann Ihnen helfen, ungewöhnliche Aktivitäten oder potenzielle Sicherheitsverletzungen frühzeitig zu erkennen.

Denken Sie darüber nach, Warnungen für ungewöhnliche Nutzungsmuster einzurichten. Sie können auch Rotationsrichtlinien für Ihre API-Schlüssel verwenden, um die Sicherheit zu verbessern.

Überlegen Sie außerdem, datenschutzorientierte Browser zu verwenden, wenn Sie online mit generativen KI-Werkzeugen interagieren. Diese Browser helfen, die Datensammlung während des Web-Browsens zu begrenzen. Sie bieten zusätzlichen Schutz für Ihre persönlichen Informationen. Sie verfügen oft über eingebaute Funktionen wie Tracker-Blockierung, Fingerabdruckschutz und automatische private Browsing-Modi.

Durch die Verwendung dieser Browser kann die Menge der über Ihre KI-Interaktionen gesammelten Daten reduziert werden. Dies kann Ihre Privatsphäre online schützen, auch wenn es keine vollständige Lösung ist.

Für Organisationen:

- Zugriffskontrollen implementieren: Beschränken Sie, wer innerhalb der Organisation ChatGPT oder dessen API nutzen kann.

- Protokollierungssysteme einrichten: Erstellen Sie robuste Protokolle aller KI-Interaktionen zur Überprüfung.

- Regelmäßige Audits durchführen: Überprüfen Sie periodisch Chatprotokolle und API-Nutzung auf potenzielle Sicherheitsprobleme.

- Mitarbeiterausbildung: Schulen Sie das Personal in bewährten Verfahren zur Nutzung generativer KI-Werkzeuge.

Die Rolle spezialisierter Prüfungswerkzeuge

Spezialisierte Werkzeuge können den Prüfungsprozess erheblich verbessern. Sie bieten Funktionen wie:

- Automatisierte Protokollanalyse: Schnelle Identifizierung potenzieller Datenschutzverletzungen.

- Echtzeitüberwachung: Verfolgung der KI-Interaktionen in Echtzeit.

- Anpassbare Warnungen: Einrichten von Benachrichtigungen für bestimmte Arten der Datennutzung.

- Compliance Berichterstattung: Erstellung von Berichten zur Erfüllung regulatorischer Anforderungen.

DataSunrise: Eine umfassende Lösung für ChatGPT-Prüfungen

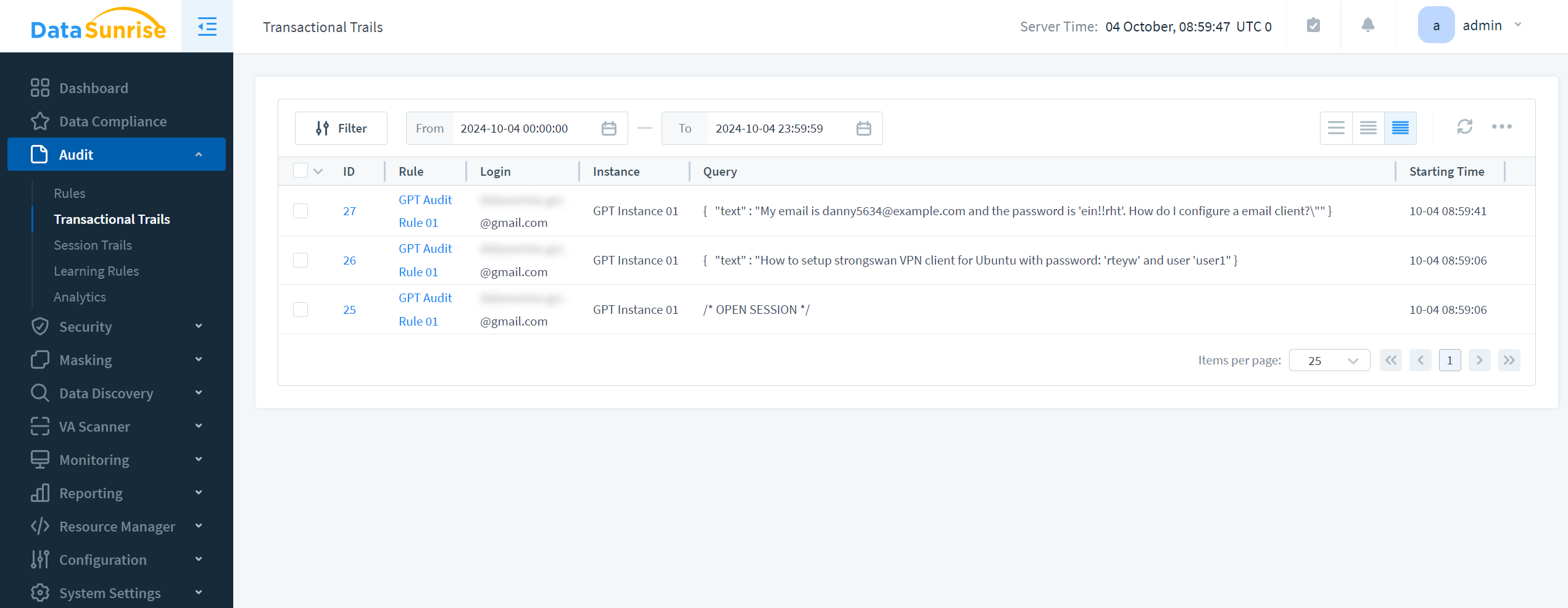

DataSunrise bietet leistungsstarke ChatGPT-Prüffunktionen und speichert Prüfdaten in einem standardisierten Format. Ihre Lösung nutzt Proxy-Technologie, um GPT-Sitzungen umfassend zu prüfen. Das Setup im Web-Anwendungsmodus, basierend auf einer Docker Compose-Datei, gewährleistet eine einfache und zuverlässige Implementierung.

Unsere Standard-Benutzeroberfläche funktioniert nahtlos über alle Transaktionspfade hinweg. Unabhängig davon, welche Daten Sie prüfen, werden Sie die gleichen Werkzeuge finden. Diese Werkzeuge helfen Ihnen, Transaktionen zu verfolgen, Instanzen zu erstellen und Berichte zu generieren. Dieser konsistente Ansatz vereinfacht Ihren Arbeitsablauf, egal ob Sie mit Datenbankoperationen, ChatGPT-Interaktionen oder Salesforce-Aktivitäten zu tun haben.

Schlussfolgerung: Innovation und Datenschutz in Einklang bringen

Während sich generative KI weiterentwickelt, müssen sich auch unsere Ansätze zu Datenschutz und Sicherheit weiterentwickeln. Wir können KI sicher nutzen, indem wir die Risiken verstehen. Wir sollten Schutzmaßnahmen und starke Prüfwerkzeuge nutzen. Dies wird uns helfen, unsere persönlichen Informationen zu schützen.

Regelmäßige Prüfungen, Benutzerschulungen und starke Werkzeuge wie die von DataSunrise helfen, Datenschutzverletzungen in der generativen KI zu verhindern. Diese Elemente arbeiten zusammen, um Schwachstellen zu identifizieren, den verantwortungsvollen Umgang mit KI zu fördern und schnelle Reaktionen auf potenzielle Probleme zu ermöglichen. Durch proaktive Überwachung, informierte Benutzer und fortschrittliche Technologien können Organisationen die Innovation der KI mit dem Datenschutz in Einklang bringen. Dieser Ansatz hilft, eine sicherere und geschütztere Zukunft für KI zu schaffen.

DataSunrise bietet flexible und modernste Werkzeuge für die Datenbanksicherheit, einschließlich umfassender Prüf- und Compliance-Lösungen. Diese Werkzeuge sind Teil einer umfassenderen Suite von Funktionen, die darauf abzielen, sensible Daten über verschiedene Plattformen hinweg zu schützen. Um zu sehen, wie DataSunrise die Datensicherheit Ihrer Organisation verbessern kann, besuchen Sie unsere Website. Dort können Sie unser Online-Demo ausprobieren.