Una Guía para la Auditoría de IA Generativa

El 35% de las empresas tecnológicas están adoptando IA generativa. En la era digital actual, la inteligencia artificial se ha convertido en una parte integral de nuestras vidas. La IA generativa, como ChatGPT, ofrece capacidades increíbles, pero también plantea importantes preocupaciones sobre la privacidad.

Este artículo aborda la Auditoría de IA Generativa. Explora los riesgos que enfrentan los usuarios y cómo pueden proteger su información personal.

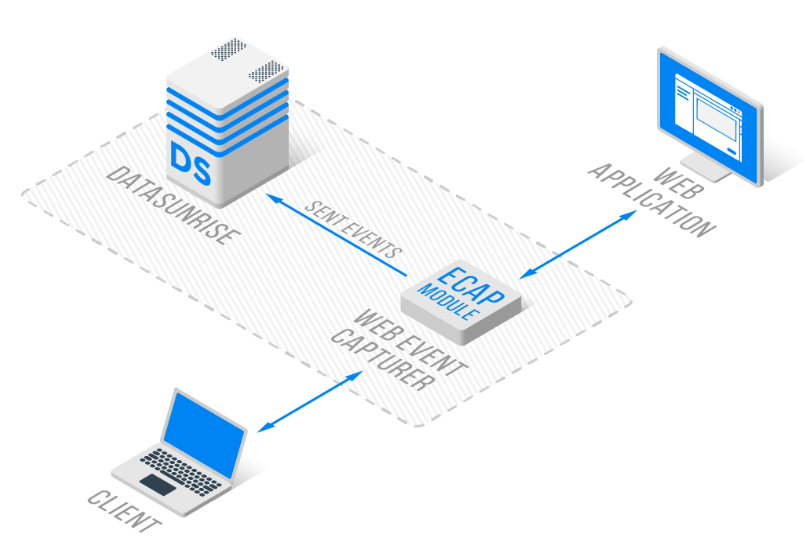

DataSunrise ahora ofrece un quinto modo de operación: Modo de aplicación web. Este modo avanzado incorpora tecnologías de vanguardia para proporcionar una solución robusta y flexible. Se integra perfectamente con nuestra interfaz de usuario existente mientras proporciona seguridad uniforme tanto para las aplicaciones de ChatGPT como para Salesforce.

Los usuarios pueden usar las mismas herramientas familiares que usan para bases de datos regulares. Esto asegura una transición fluida y una experiencia consistente a través de diferentes fuentes de datos.

El Auge de la IA Generativa y Sus Implicaciones en la Privacidad

La IA generativa ha revolucionado la forma en que interactuamos con la tecnología. Sin embargo, a medida que los usuarios se conectan a plataformas como ChatGPT, a menudo pasan por alto los posibles riesgos de privacidad. Entender estos riesgos es crucial para proteger información personal en un mundo cada vez más impulsado por IA.

Riesgos de Privacidad al Usar ChatGPT

Al interactuar con ChatGPT, los usuarios pueden exponerse inadvertidamente a varios riesgos de privacidad:

- Recolección de Datos: ChatGPT almacena historiales de conversaciones, los cuales pueden contener información sensible.

- Divulgación Involuntaria de Información: Los usuarios podrían compartir accidentalmente detalles personales durante las conversaciones.

- Acceso a Terceros: Existe la posibilidad de acceso no autorizado a los datos almacenados.

- Aprendizaje de la IA a Partir de Datos Personales: El modelo de IA puede incorporar datos de usuarios en sus procesos de aprendizaje.

- Vinculación de Información entre Sesiones: Múltiples conversaciones podrían vincularse, revelando patrones sobre un usuario.

Protegiendo la Información Personal en Consultas a ChatGPT

Para mitigar los riesgos de privacidad al usar ChatGPT, considere estas estrategias:

- Minimizar la Información Personal: Evite compartir detalles personales innecesarios en sus consultas.

- Usar Seudónimos: Cuando sea posible, use datos enmascarados en lugar de nombres reales.

- Ser Cauteloso con Temas Sensibles: Absténgase de discutir asuntos altamente personales.

- Borrar Regularmente el Historial de Chat: Elimine periódicamente su historial de conversaciones.

- Revisar Políticas de Privacidad: Comprenda cómo la plataforma maneja y protege los datos de los usuarios.

Auditoría de Sesiones de Chat y Uso de API

Auditar las sesiones de chat y el uso de API es crucial para mantener la privacidad y seguridad. Así es cómo abordarlo:

Para Usuarios Individuales:

Revisar regularmente los registros de sus conversaciones es un paso crucial para mantener la privacidad al usar herramientas de IA generativa. Tómese un tiempo para revisar su historial de chat regularmente. Busque cualquier información sensible que pueda haber compartido por error.

Esta práctica le ayuda a identificar posibles riesgos de privacidad. También lo hace más consciente de la información que comparte con los sistemas de IA. Si detecta cualquier dato preocupante, considere eliminar esos mensajes específicos o borrar todo su historial de chat si es necesario.

Para aquellos que utilizan la API, monitorear el uso de su clave API es esencial. Lleve un registro de cuándo y cómo está usando su clave para asegurarse de que no haya caído en manos no autorizadas. Esta vigilancia puede ayudar a detectar cualquier actividad inusual o posibles filtraciones de seguridad en una etapa temprana.

Piense en configurar alertas para patrones de uso inusuales. También puede usar políticas de rotación para sus claves API para mejorar la seguridad.

Finalmente, considere usar navegadores enfocados en la privacidad cuando interactúe con herramientas de IA generativa en línea. Estos navegadores ayudan a limitar la recopilación de datos mientras navega por la web. Proporcionan protección adicional para su información personal. A menudo vienen con funciones integradas como bloqueo de rastreadores, protección contra huellas digitales y modos automáticos de navegación privada.

Usar estos navegadores puede ayudar a reducir los datos recopilados sobre sus interacciones con IA. Esto puede proteger su privacidad en línea, incluso si no es una solución completa.

Para Organizaciones:

- Implementar Controles de Acceso: Restringir quién puede usar ChatGPT o su API dentro de la organización.

- Configurar Sistemas de Registro: Crear registros robustos de todas las interacciones con IA para su revisión.

- Realizar Auditorías Regulares: Revisar periódicamente los registros de chat y el uso de API en busca de posibles problemas de seguridad.

- Capacitar a los Empleados: Educar al personal sobre las mejores prácticas para usar herramientas de IA generativa.

El Papel de las Herramientas de Auditoría Especializadas

Las herramientas especializadas pueden mejorar significativamente el proceso de auditoría. Ofrecen características como:

- Análisis de Registros Automatizados: Identificar rápidamente posibles fallas de privacidad.

- Monitoreo en Tiempo Real: Rastrear las interacciones con la IA a medida que ocurren.

- Alertas Personalizables: Configurar notificaciones para tipos específicos de uso de datos.

- Reportes de Cumplimiento: Generar informes para cumplir con los requisitos regulatorios.

DataSunrise: Una Solución Integral para la Auditoría de ChatGPT

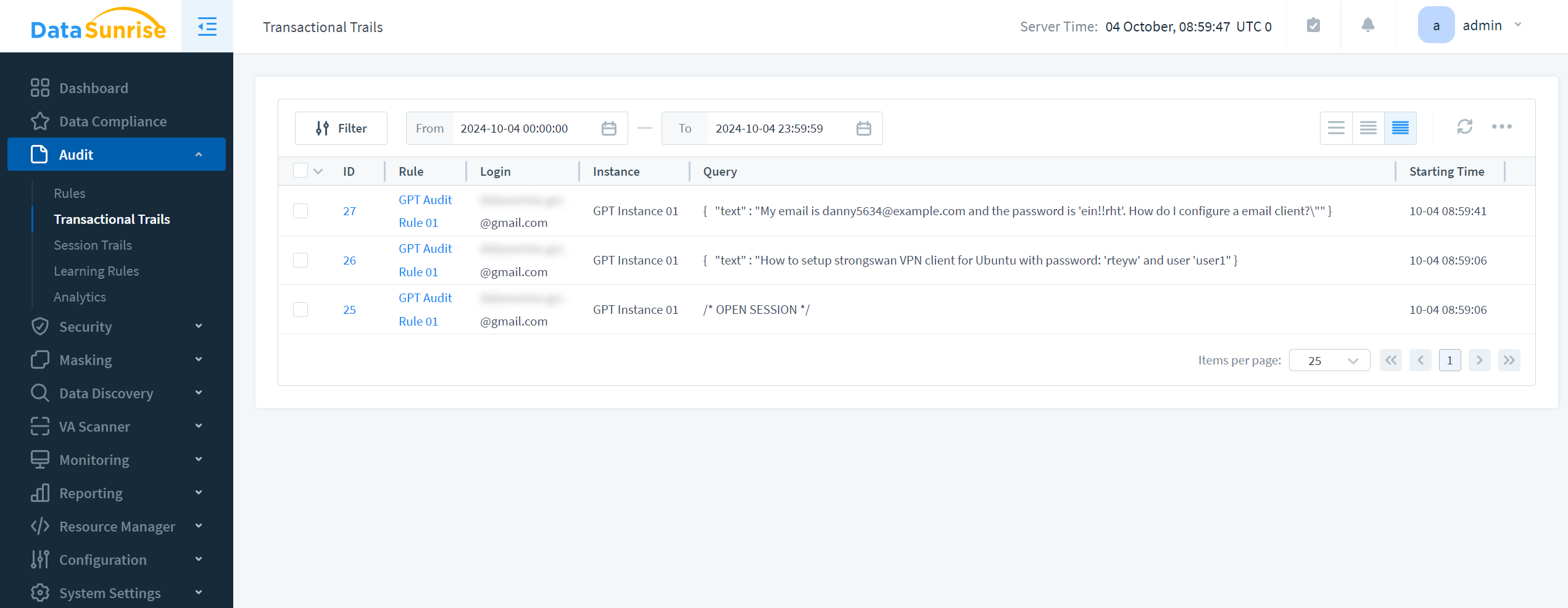

DataSunrise ofrece capacidades poderosas de Auditoría de ChatGPT, almacenando datos de auditoría en un formato estandarizado. Su solución utiliza tecnología proxy para auditar sesiones GPT de manera comprensiva. La configuración del modo de aplicación web, basada en un archivo Docker compose, asegura una implementación fácil y confiable.

Nuestra interfaz de usuario estándar funciona perfectamente en todas las trayectorias transaccionales. No importa qué datos esté auditando, encontrará las mismas herramientas. Estas herramientas le ayudan a rastrear transacciones, crear instancias y generar informes. Este enfoque consistente simplifica su flujo de trabajo, ya sea que esté tratando con operaciones de bases de datos, interacciones con ChatGPT o actividades de Salesforce.

Conclusión: Equilibrando Innovación y Privacidad

A medida que la IA generativa continúa evolucionando, también deben hacerlo nuestros enfoques hacia la privacidad y la seguridad. Podemos usar la IA de manera segura entendiendo los riesgos. Debemos usar medidas de protección y herramientas de auditoría robustas. Esto nos ayudará a proteger nuestra información personal.

Las auditorías regulares, la capacitación de usuarios y herramientas robustas como las de DataSunrise ayudan a proteger contra fallas de privacidad en IA generativa. Estos elementos trabajan juntos para identificar vulnerabilidades, promover el uso responsable de la IA y permitir respuestas rápidas a posibles problemas. Al usar monitoreo proactivo, usuarios informados y tecnologías avanzadas, las organizaciones pueden equilibrar la innovación en IA con la protección de la privacidad. Este enfoque ayuda a crear un futuro más seguro y protegido para la IA.

DataSunrise proporciona herramientas flexibles y de vanguardia para la seguridad de bases de datos, incluidas soluciones completas de auditoría y cumplimiento. Estas herramientas son parte de una suite más amplia de características diseñadas para proteger datos sensibles a través de varias plataformas. Para ver cómo DataSunrise puede mejorar la seguridad de los datos de su organización, visite nuestro sitio web. Puede probar nuestra demostración en línea allí.