Un Guide d’Audit de l’IA Générative

35 % des entreprises technologiques adoptent l’IA générative. À l’ère numérique actuelle, l’intelligence artificielle est devenue une partie intégrante de nos vies. L’IA générative, comme ChatGPT, offre des capacités incroyables mais soulève également des préoccupations importantes en matière de confidentialité.

Cet article aborde l’Audit de l’IA Générative. Il explore les risques auxquels les utilisateurs font face et comment ils peuvent protéger leurs informations personnelles.

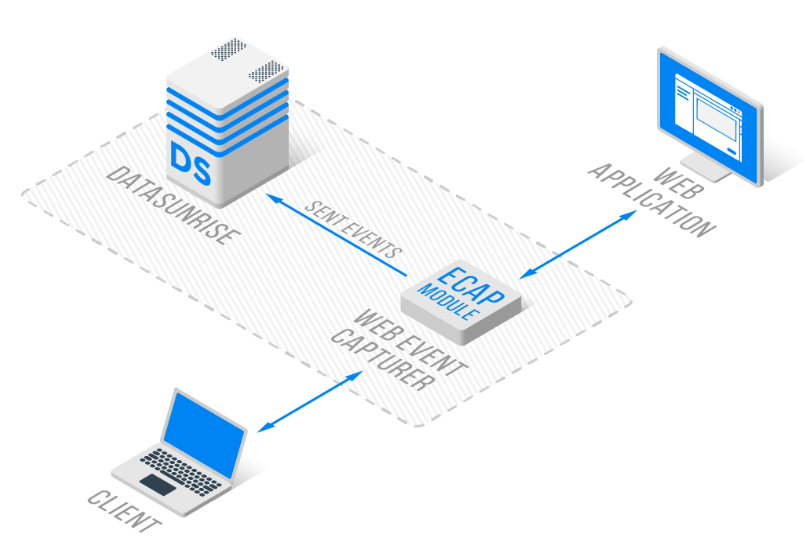

DataSunrise propose désormais un cinquième mode de fonctionnement : le mode application web. Ce mode avancé intègre des technologies de pointe pour offrir une solution robuste et flexible. Il s’intègre parfaitement à notre interface utilisateur existante tout en fournissant une sécurité uniforme pour les applications ChatGPT et Salesforce.

Les utilisateurs peuvent utiliser les mêmes outils familiers qu’ils utilisent pour les bases de données régulières. Cela garantit une transition en douceur et une expérience cohérente entre différentes sources de données.

La Montée de l’IA Générative et Ses Implications en Matière de Confidentialité

L’IA générative a révolutionné notre interaction avec la technologie. Cependant, à mesure que les utilisateurs se connectent à des plateformes comme ChatGPT, ils négligent souvent les risques potentiels pour la confidentialité. Comprendre ces risques est crucial pour protéger les informations personnelles dans un monde de plus en plus axé sur l’IA.

Risques de Confidentialité Lors de l’Utilisation de ChatGPT

Lorsqu’ils interagissent avec ChatGPT, les utilisateurs peuvent involontairement s’exposer à plusieurs risques de confidentialité :

- Collecte de Données : ChatGPT stocke les historiques de conversation, qui peuvent contenir des informations sensibles.

- Divulgation Involontaire d’Informations : Les utilisateurs peuvent partager accidentellement des détails personnels lors des conversations.

- Accès de Tiers : Il existe un potentiel d’accès non autorisé aux données stockées.

- Apprentissage de l’IA à partir des Données Personnelles : Le modèle d’IA peut intégrer les données des utilisateurs dans ses processus d’apprentissage.

- Liage d’Informations entre Sessions : Plusieurs conversations peuvent être liées, révélant des schémas sur un utilisateur.

Protéger les Informations Personnelles dans les Requêtes ChatGPT

Pour atténuer les risques de confidentialité lors de l’utilisation de ChatGPT, considérez ces stratégies :

- Minimiser les Informations Personnelles : Évitez de partager des détails personnels inutiles dans vos requêtes.

- Utiliser des Pseudonymes : Lorsque possible, utilisez des données masquées au lieu de vrais noms.

- Soyez Prudent avec les Sujets Sensibles : Évitez de discuter de sujets hautement personnels.

- Effacer Régulièrement l’Historique des Conversations : Supprimez périodiquement votre historique de conversation.

- Revoir les Politiques de Confidentialité : Comprenez comment la plateforme gère et protège les données des utilisateurs.

Auditer les Sessions de Chat et l’Utilisation des API

Auditer les sessions de chat et l’utilisation des API est crucial pour maintenir la confidentialité et la sécurité. Voici comment l’aborder :

Pour les Utilisateurs Individuels :

Revoir régulièrement vos journaux de conversation est une étape cruciale pour maintenir la confidentialité lors de l’utilisation d’outils d’IA générative. Prenez le temps de revoir régulièrement votre historique de chat. Recherchez toute information sensible que vous auriez pu partager par erreur.

Cette pratique vous aide à repérer les risques potentiels pour la vie privée. Elle vous sensibilise également davantage aux informations que vous partagez avec les systèmes d’IA. Si vous repérez des données préoccupantes, envisagez de supprimer ces messages spécifiques ou de vider votre historique de chat selon besoin.

Pour ceux qui utilisent l’API, la surveillance de l’utilisation de votre clé API est essentielle. Suivez quand et comment vous utilisez votre clé pour vous assurer qu’elle n’est pas tombée entre de mauvaises mains. Cette vigilance peut vous aider à détecter rapidement toute activité inhabituelle ou toute violation de sécurité potentielle.

Pensez à configurer des alertes pour des modèles d’utilisation inhabituels. Vous pouvez également utiliser des politiques de rotation pour vos clés API pour améliorer la sécurité.

Enfin, songez à utiliser des navigateurs axés sur la confidentialité lorsque vous interagissez avec des outils d’IA générative en ligne. Ces navigateurs contribuent à limiter la collecte de données pendant que vous naviguez sur le web. Ils ajoutent une protection supplémentaire pour vos informations personnelles. Ils sont souvent dotés de fonctionnalités intégrées telles que le blocage des traqueurs, la protection contre le fingerprinting et les modes de navigation privée automatiques.

L’utilisation de ces navigateurs peut aider à réduire les données recueillies sur vos interactions avec l’IA. Cela peut protéger votre vie privée en ligne, même si ce n’est pas une solution complète.

Pour les Organisations :

- Implémenter des Contrôles d’Accès : Restreindre qui peut utiliser ChatGPT ou son API au sein de l’organisation.

- Configurer des Systèmes de Journalisation : Créer des journaux robustes de toutes les interactions avec l’IA pour révision.

- Conduire des Audits Réguliers : Revoir périodiquement les journaux de chats et l’utilisation des API pour repérer d’éventuels problèmes de sécurité.

- Former les Employés : Éduquer le personnel sur les meilleures pratiques pour utiliser les outils d’IA générative.

Le Rôle des Outils d’Audit Spécialisés

Les outils spécialisés peuvent grandement améliorer le processus d’audit. Ils offrent des fonctionnalités telles que :

- Analyse Automatisée des Journaux : Identifier rapidement les violations potentielles de la vie privée.

- Surveillance en Temps Réel : Suivre les interactions avec l’IA au fur et à mesure qu’elles se produisent.

- Alertes Personnalisables : Configurer des notifications pour des types spécifiques d’utilisation des données.

- Génération de Rapports de Conformité : Créer des rapports pour répondre aux exigences réglementaires.

DataSunrise : Une Solution Complète pour l’Audit de ChatGPT

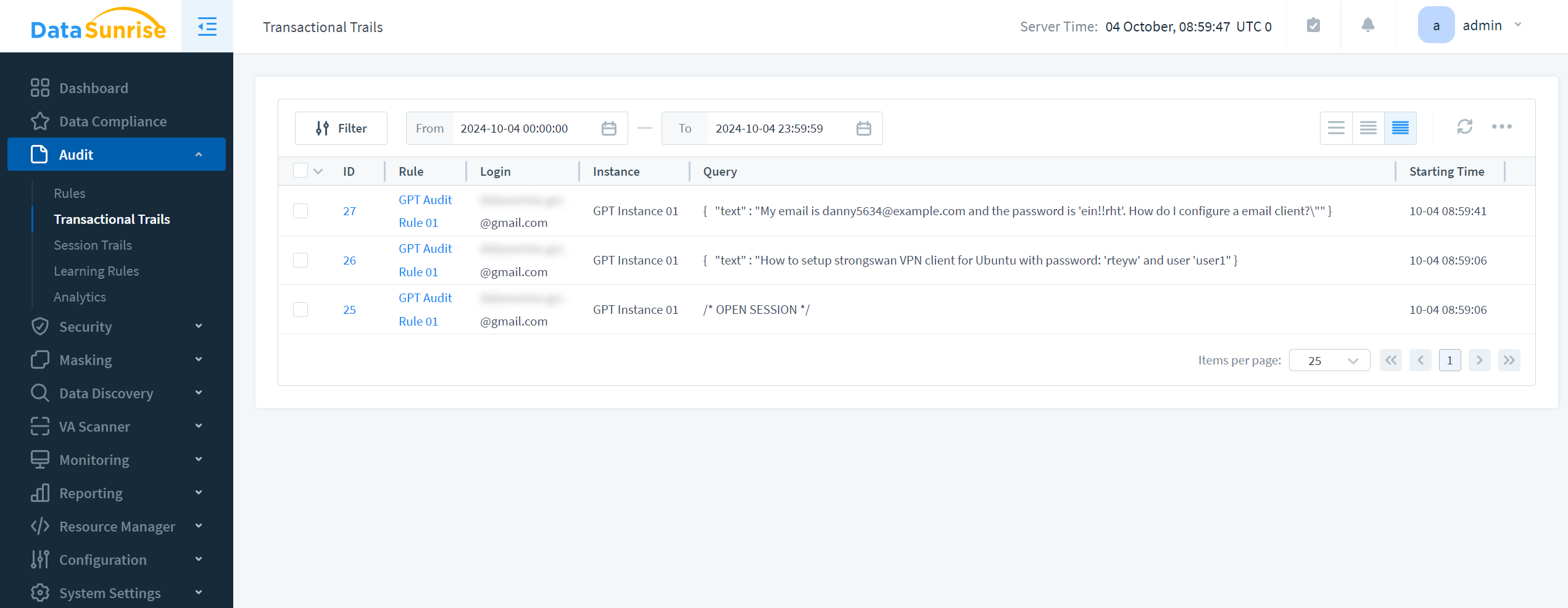

DataSunrise offre des capacités puissantes d’audit ChatGPT, stockant les données d’audit dans un format standardisé. Leur solution utilise une technologie de proxy pour auditer de manière exhaustive les sessions GPT. Le mode application web, basé sur un fichier Docker compose, assure une mise en œuvre facile et fiable.

Notre interface utilisateur standard fonctionne parfaitement sur tous les parcours transactionnels. Peu importe les données que vous auditez, vous trouverez les mêmes outils. Ces outils vous aident à suivre les transactions, créer des instances et générer des rapports. Cette approche cohérente simplifie votre flux de travail, que vous traitiez des opérations de base de données, des interactions avec ChatGPT ou des activités Salesforce.

Conclusion : Équilibrer Innovation et Confidentialité

À mesure que l’IA générative continue d’évoluer, nos approches en matière de confidentialité et de sécurité doivent également évoluer. Nous pouvons utiliser l’IA en toute sécurité en comprenant les risques. Nous devons utiliser des mesures de protection et des outils d’audit solides. Cela nous aidera à protéger nos informations personnelles.

Des audits réguliers, la formation des utilisateurs, et des outils robustes comme ceux de DataSunrise aident à se protéger contre les violations de la confidentialité dans l’IA générative. Ces éléments travaillent ensemble pour identifier les vulnérabilités, promouvoir l’utilisation responsable de l’IA et permettre des réponses rapides aux problèmes potentiels. En utilisant une surveillance proactive, des utilisateurs informés et des technologies avancées, les organisations peuvent équilibrer l’innovation de l’IA avec la protection de la vie privée. Cette approche aide à créer un avenir plus sûr et plus sécurisé pour l’IA.

DataSunrise fournit des outils flexibles et de pointe pour la sécurité des bases de données, y compris des solutions complètes d’audit et de conformité. Ces outils font partie d’une suite plus large de fonctionnalités conçues pour protéger les données sensibles sur diverses plateformes. Pour voir comment DataSunrise peut améliorer la sécurité des données de votre organisation, visitez notre site web. Vous pouvez essayer notre démonstration en ligne là-bas.