Audit Generative AI

Nell’evoluzione rapida dell’intelligenza artificiale, l’AI generativa è diventata un pilastro dell’innovazione. Da ChatGPT di OpenAI a Bedrock di Amazon e altre piattaforme emergenti, queste tecnologie stanno ridefinendo il modo in cui interagiamo con le macchine. Tuttavia, questa rivoluzione porta con sé preoccupazioni significative sulla privacy, specialmente riguardo alla gestione delle Informazioni di Identificazione Personale (PII).

Questo articolo esamina gli effetti più ampi degli audit AI generativi. Si discute dei possibili rischi di privacy e dei modi per migliorare l’audit e la sicurezza.

Il Mondo in Espansione dell’Audit Generative AI

L’AI generativa ha superato una singola piattaforma. Oggi vediamo un ecosistema variegato:

- ChatGPT di OpenAI: Un’AI conversazionale che è diventata sinonimo di capacità generative.

- Amazon Bedrock: Un servizio gestito completamente che consente un’integrazione facile dei modelli di fondazione nelle applicazioni.

- Bard di Google: Un servizio sperimentale di AI conversazionale alimentato da LaMDA.

- Azure OpenAI Service di Microsoft: Fornisce accesso ai modelli di OpenAI con le funzionalità di sicurezza e enterprise di Azure.

Queste piattaforme forniscono accesso API per sviluppatori e interfacce web per utenti. Questo aumenta notevolmente il rischio di violazioni dei dati.

Rischi di Privacy nel Panoramica Generative AI

L’adozione diffusa di AI generativa introduce diverse preoccupazioni sulla privacy:

- Conservazione dei Dati: I modelli AI possono memorizzare input per miglioramenti, potenzialmente inclusi dati sensibili.

- Divulgazione Involontaria di Informazioni: Gli utenti potrebbero accidentalmente rivelare PII durante le interazioni.

- Sfruttamento del Modello: Attacchi sofisticati potrebbero potenzialmente estrarre dati di addestramento dai modelli.

- Aggregazione di Dati Multi-Piattaforma: Utilizzando più servizi AI si potrebbero creare profili utente completi.

- Vulnerabilità API: Implementazioni API non sicure potrebbero esporre dati degli utenti.

Strategie Generali per Mitigare i Rischi di Privacy

Per affrontare queste preoccupazioni, le organizzazioni dovrebbero considerare i seguenti approcci:

- Minimizzazione dei Dati: Limitare la quantità di dati personali elaborati dai sistemi AI.

- Anonimizzazione e Pseudonimizzazione: Trasformare dati per rimuovere o oscurare informazioni identificative.

- Crittografia: Implementare una forte crittografia per i dati in transito e a riposo.

- Controlli di Accesso: Gestire rigorosamente chi può accedere ai sistemi AI e ai dati memorizzati.

- Audit di Sicurezza Regolari: Condurre revisioni approfondite dei sistemi AI e delle loro pratiche di gestione dei dati.

- Educazione degli Utenti: Informare gli utenti sui rischi e le migliori pratiche durante l’interazione con l’AI.

- Quadri Normativi: Allineare l’uso dell’AI con regolamenti come GDPR, CCPA, e standard specifici del settore.

Audit delle Interazioni Generative AI: Aspetti Chiave

L’audit efficace è cruciale per mantenere la sicurezza e la conformità. Gli aspetti chiave includono:

- Logging Completo: Registrare tutte le interazioni, inclusi input degli utenti e risposte AI.

- Monitoraggio in Tempo Reale: Implementare sistemi per rilevare e allertare immediatamente sulle potenziali violazioni della privacy.

- Analisi dei Pattern: Utilizzare il machine learning per identificare modelli di utilizzo inusuali che potrebbero indicare un uso improprio.

- Revisioni Periodiche: Esaminare regolarmente i log e i pattern di utilizzo per garantire conformità e identificare potenziali rischi.

- Audit di Terzi: Coinvolgere esperti esterni per fornire valutazioni imparziali sull’uso dell’AI e le misure di sicurezza.

DataSunrise: Una Soluzione Completa per l’Audit AI

DataSunrise offre una soluzione robusta per l’audit delle interazioni AI generative su varie piattaforme. Il nostro sistema si integra perfettamente con diversi servizi AI, fornendo un approccio unificato alla sicurezza e alla conformità.

Componenti Chiave della Soluzione di Audit AI di DataSunrise:

- Servizio Proxy: Intercetta e analizza il traffico tra utenti e piattaforme AI.

- Scoperta dei Dati: Identifica e classifica automaticamente le informazioni sensibili nelle interazioni AI.

- Monitoraggio in Tempo Reale: Fornisce avvisi immediati sulle potenti violazioni della privacy.

- Audit Logging: Crea log dettagliati e a prova di manomissione di tutte le interazioni AI.

- Reportistica di Conformità: Genera report adattati ai vari requisiti normativi.

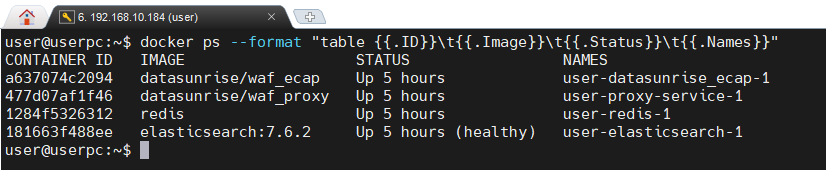

L’immagine seguente mostra quattro contenitori Docker in esecuzione. Questi contenitori forniscono funzionalità di Firewall dell’Applicazione Web di DataSunrise, migliorando la sicurezza del sistema mostrato.

Esempio di Installazione con DataSunrise

Un’installazione tipica di DataSunrise per l’audit AI potrebbe includere:

- Proxy di DataSunrise: Implementato come un reverse proxy davanti ai servizi AI.

- Redis: Per caching e gestione delle sessioni, migliorando le performance.

- Elasticsearch: Per archiviazione e recupero efficienti dei log di audit.

- Kibana: Per visualizzare i dati di audit e creare dashboard personalizzati.

- Console di Gestione DataSunrise: Per configurare le politiche e visualizzare i report.

Questa configurazione può essere facilmente implementata utilizzando strumenti di orchestrazione dei contenitori come Docker e Kubernetes, garantendo scalabilità e facilità di gestione.

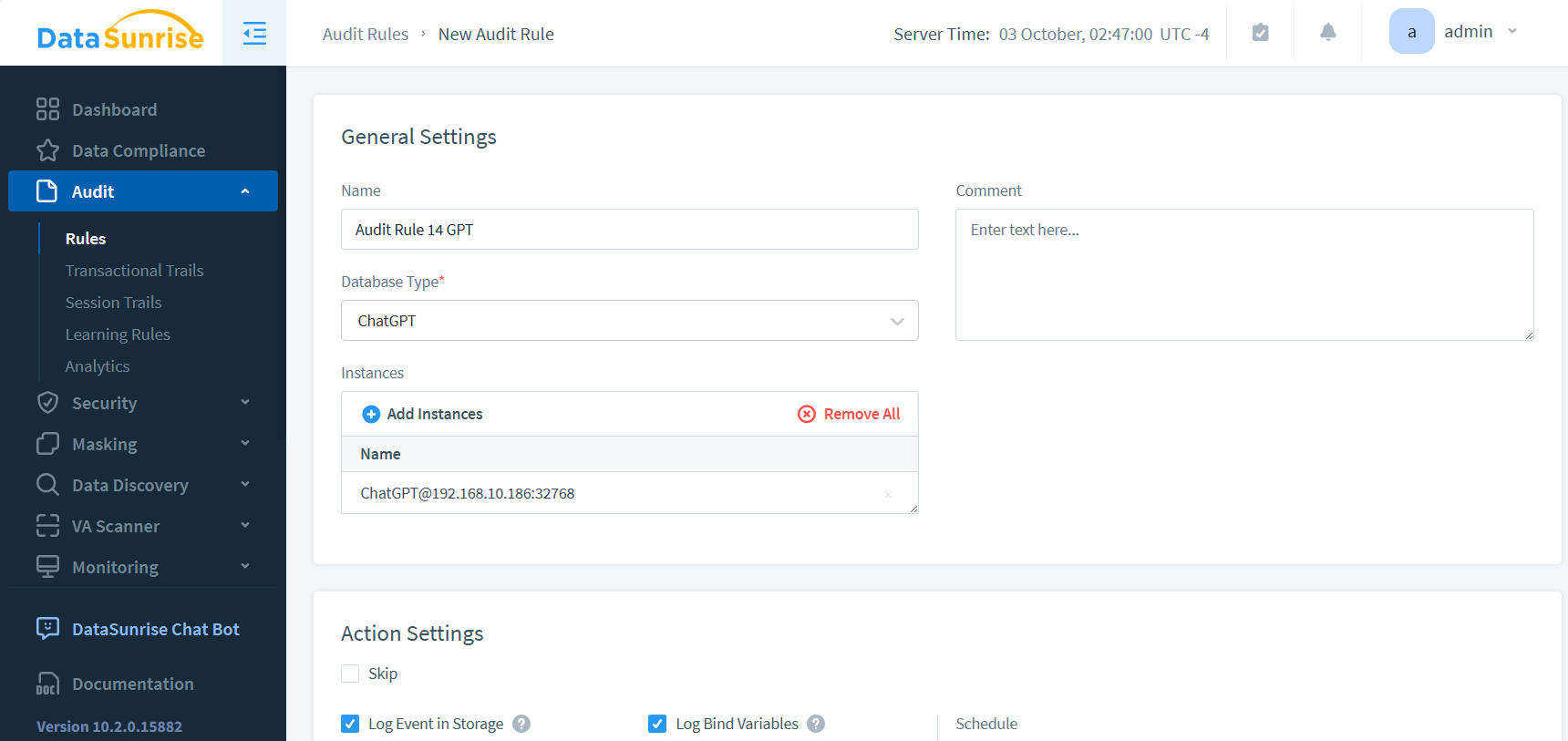

La configurazione delle regole di audit è semplice. In questo caso, selezioniamo l’istanza rilevante, che non è un database ma piuttosto una web application, come ChatGPT. Questo processo dimostra la flessibilità del sistema di audit nel gestire vari tipi di applicazioni.

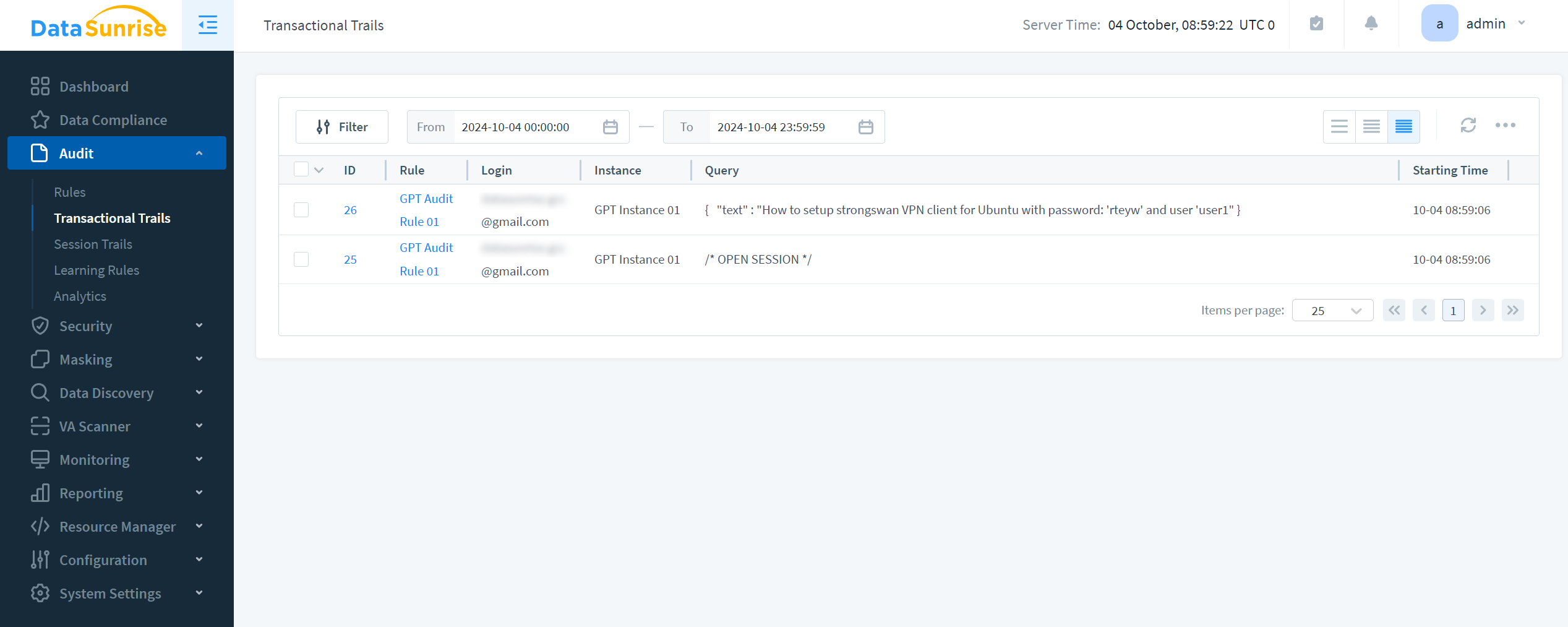

I risultati dell’audit e il prompt GPT corrispondente sono i seguenti:

Conclusione: Abbracciare l’AI con Fiducia

L’AI generativa sta diventando parte della nostra vita quotidiana e delle aziende. Man mano che evolve, abbiamo bisogno di forti misure di audit e sicurezza. Queste misure sono essenziali per la sicurezza.

Utilizzando strategie chiare e strumenti avanzati da DataSunrise, le organizzazioni possono utilizzare efficacemente l’AI. Possono anche mantenere i dati al sicuro e proteggere la privacy.

Il futuro dell’AI è luminoso, ma deve essere costruito su una base di fiducia e sicurezza. Con l’uso di misure adeguate di audit e privacy, possiamo sbloccare completamente il potenziale dell’AI generativa. Questo aiuterà a proteggere i diritti e le informazioni sia degli individui che delle organizzazioni.

DataSunrise: Il Tuo Partner nella Sicurezza AI

DataSunrise è leader nella sicurezza AI. Fornisce non solo strumenti di audit ma anche un set completo di funzionalità. Questi strumenti proteggono i tuoi dati su diverse piattaforme e database.

La nostra soluzione si adatta alle sfide specifiche dell’AI generativa. Questo aiuta la tua organizzazione a rimanere avanti rispetto alle potenziali minacce.

Ti invitiamo a esplorare come DataSunrise può migliorare la postura di sicurezza della tua AI. Visita il sito Web di DataSunrise per pianificare una demo. Scopri come le nostre soluzioni avanzate possono aiutarti a gestire la governance dell’AI e la protezione dei dati.