Una Guida all’Audit dell’IA Generativa

Il 35% delle aziende tecnologiche sta adottando l’IA generativa. Nell’era digitale odierna, l’intelligenza artificiale è diventata parte integrante delle nostre vite. L’IA generativa, come ChatGPT, offre capacità incredibili ma solleva anche importanti preoccupazioni sulla privacy.

Questo articolo esamina l’Audit dell’IA Generativa. Esplora i rischi che gli utenti affrontano e come possono proteggere le loro informazioni personali.

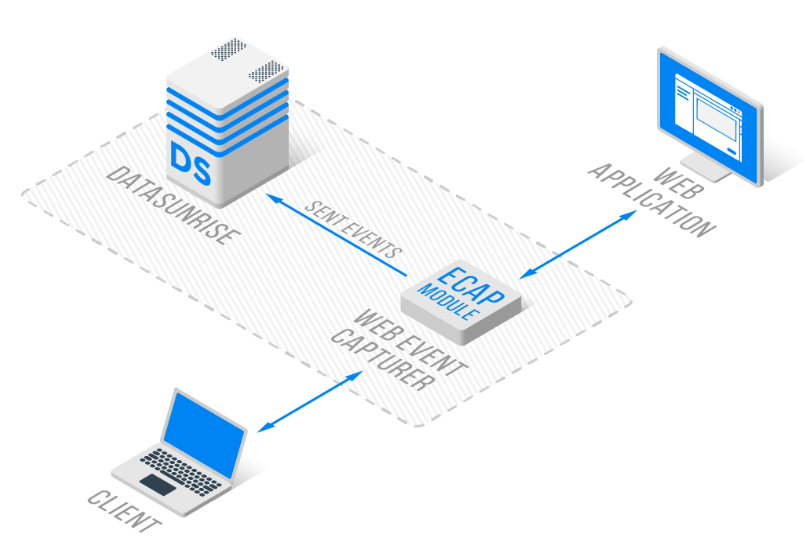

DataSunrise ora offre una quinta modalità operativa: modalità applicazione Web. Questa modalità avanzata incorpora tecnologie all’avanguardia per fornire una soluzione robusta e flessibile. Si integra perfettamente con la nostra interfaccia utente esistente, fornendo sicurezza uniforme sia per le applicazioni ChatGPT sia per Salesforce.

Gli utenti possono utilizzare gli stessi strumenti familiari che usano per i database regolari. Questo garantisce una transizione fluida e un’esperienza coerente tra le diverse fonti di dati.

L’Ascesa dell’IA Generativa e le sue Implicazioni per la Privacy

L’IA generativa ha rivoluzionato il nostro modo di interagire con la tecnologia. Tuttavia, man mano che gli utenti si connettono a piattaforme come ChatGPT, spesso trascurano i potenziali rischi per la privacy. Comprendere questi rischi è cruciale per salvaguardare le informazioni personali in un mondo sempre più guidato dall’IA.

Rischi per la Privacy Quando si Utilizza ChatGPT

Quando interagiscono con ChatGPT, gli utenti possono inconsapevolmente esporsi a diversi rischi per la privacy:

- Raccolta Dati: ChatGPT memorizza le cronologie delle conversazioni, che possono contenere informazioni sensibili.

- Divulgazione Involontaria di Informazioni: Gli utenti potrebbero accidentalmente condividere dettagli personali durante le conversazioni.

- Accesso di Terze Parti: C’è il potenziale per accessi non autorizzati ai dati memorizzati.

- Apprendimento dell’IA dai Dati Personali: Il modello di IA potrebbe incorporare i dati degli utenti nei suoi processi di apprendimento.

- Collegamento delle Informazioni attraverso Sessioni: Più conversazioni potrebbero essere collegate, rivelando schemi su un utente.

Proteggere le Informazioni Personali nelle Query di ChatGPT

Per mitigare i rischi per la privacy quando si utilizza ChatGPT, considerare queste strategie:

- Minimizzare le Informazioni Personali: Evitare di condividere dettagli personali non necessari nelle query.

- Usare Pseudonimi: Quando possibile, usare dati mascherati invece di nomi reali.

- Essere Cauti con Argomenti Sensibili: Non discutere di questioni altamente personali.

- Cancellare Regolarmente la Cronologia Chat: Eliminare periodicamente la cronologia delle conversazioni.

- Rivedere le Politiche di Privacy: Capire come la piattaforma gestisce e protegge i dati degli utenti.

Auditing delle Sessioni di Chat e Uso delle API

Auditare le sessioni di chat e l’uso delle API è cruciale per mantenere la privacy e la sicurezza. Ecco come affrontarlo:

Per Utenti Individuali:

Rivedere regolarmente i registri delle conversazioni è un passo cruciale per mantenere la privacy quando si utilizzano strumenti di IA generativa. Prendersi del tempo per rivedere regolarmente la cronologia delle chat. Cercare eventuali informazioni sensibili che potrebbero essere state condivise per errore.

Questa pratica aiuta a individuare possibili rischi per la privacy. Inoltre, rende più consapevoli delle informazioni che si condividono con i sistemi di IA. Se si individuano dati preoccupanti, considerare di eliminare quei messaggi specifici o di cancellare l’intera cronologia delle chat, se necessario.

Per coloro che utilizzano l’API, monitorare l’uso della chiave API è essenziale. Tenere traccia di quando e come si usa la chiave per assicurarsi che non sia caduta in mani non autorizzate. Questa vigilanza può aiutare a rilevare precocemente qualsiasi attività insolita o potenziali violazioni di sicurezza.

Pensare a impostare avvisi per modelli di utilizzo insoliti. Si possono anche usare politiche di rotazione per le chiavi API per migliorare la sicurezza.

Infine, considerare l’uso di browser focalizzati sulla privacy quando si interagisce con strumenti di IA generativa online. Questi browser aiutano a limitare la raccolta di dati durante la navigazione sul web. Aggiungono protezione extra alle informazioni personali. Spesso includono funzionalità integrate come il blocco dei tracker, la protezione contro il fingerprinting e modalità di navigazione privata automatica.

L’uso di questi browser può aiutare a ridurre la quantità di dati raccolti sulle interazioni con l’IA. Questo può proteggere la privacy online, anche se non è una soluzione completa.

Per le Organizzazioni:

- Implementare Controlli di Accesso: Limitare chi può usare ChatGPT o la sua API all’interno dell’organizzazione.

- Impostare Sistemi di Logging: Creare log robusti di tutte le interazioni con l’IA per una revisione.

- Condurre Audit Regolari: Esaminare periodicamente i log delle chat e l’uso delle API per potenziali problemi di sicurezza.

- Formare i Dipendenti: Educare il personale sulle migliori pratiche per l’uso di strumenti di IA generativa.

Il Ruolo degli Strumenti di Audit Specializzati

Strumenti specializzati possono migliorare significativamente il processo di audit. Offrono funzionalità come:

- Analisi dei Log Automatizzata: Identificare rapidamente potenziali violazioni della privacy.

- Monitoraggio in Tempo Reale: Tracciare le interazioni con l’IA mentre accadono.

- Avvisi Personalizzabili: Impostare notifiche per specifici tipi di uso dei dati.

- Reportistica per la Conformità: Generare report per soddisfare i requisiti normativi.

DataSunrise: Una Soluzione Completa per l’Audit di ChatGPT

DataSunrise offre potenti capacità di Audit di ChatGPT, memorizzando i dati di audit in un formato standardizzato. La loro soluzione utilizza la tecnologia proxy per audire in modo completo le sessioni GPT. La configurazione della modalità applicazione web, basata su un file Docker compose, assicura un’implementazione facile e affidabile.

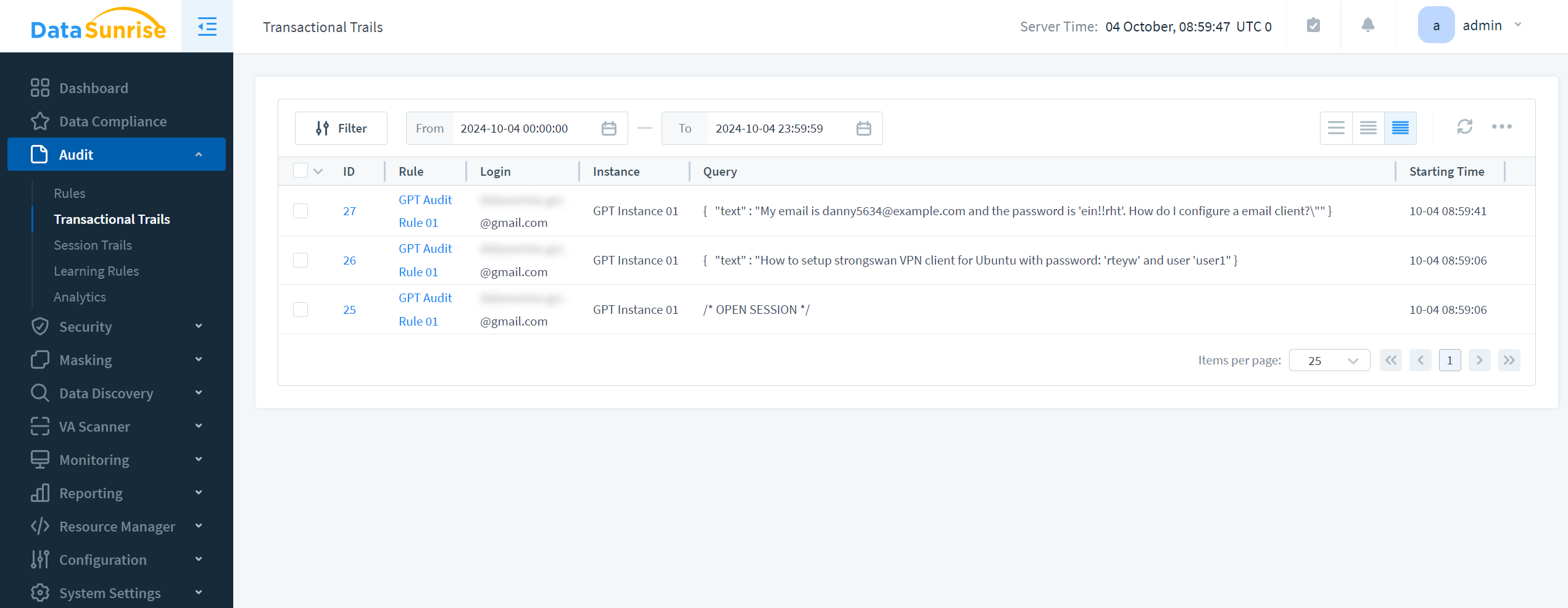

La nostra interfaccia utente standard funziona perfettamente tra tutte le tracce transazionali. Non importa quali dati si stanno auditando, si troveranno gli stessi strumenti. Questi strumenti aiutano a tracciare le transazioni, creare istanze e generare report. Questo approccio coerente semplifica il flusso di lavoro, che si tratti di operazioni di database, interazioni con ChatGPT o attività su Salesforce.

Conclusione: Bilanciare Innovazione e Privacy

Man mano che l’IA generativa continua a evolversi, devono evolvere anche i nostri approcci alla privacy e sicurezza. Possiamo usare l’IA in modo sicuro comprendendo i rischi. Dovremmo usare misure di protezione e strumenti di audit avanzati. Questo ci aiuterà a proteggere le nostre informazioni personali.

Audit regolari, formazione degli utenti e strumenti potenti come quelli di DataSunrise aiutano a proteggere contro le violazioni della privacy nell’IA generativa. Questi elementi lavorano insieme per identificare vulnerabilità, promuovere l’uso responsabile dell’IA e permettere risposte rapide a potenziali problemi. Utilizzando monitoraggio proattivo, utenti informati e tecnologie avanzate, le organizzazioni possono bilanciare l’innovazione dell’IA con la protezione della privacy. Questo approccio aiuta a creare un futuro più sicuro e protetto per l’IA.

DataSunrise fornisce strumenti flessibili e all’avanguardia per la sicurezza del database, comprese soluzioni complete di audit e conformità. Questi strumenti fanno parte di una suite più ampia di funzionalità progettate per proteggere i dati sensibili su varie piattaforme. Per vedere come DataSunrise può migliorare la sicurezza dei dati della sua organizzazione, visiti il nostro sito web. Potrà provare la demo online.